我曾在兩週前的文章〈為什麼蘋果最有機會,搶佔下一代 AI 消費性市場?〉中提到,同時手握「資料」與「隱私」的蘋果,將最可能統治下一代 AI 消費性市場。

而今年的 WWDC,蘋果便以 Apple Intelligence 展示給我們看,以「個人化」+「隱私」做出來的 AI 有多麽吸引人。

有趣的是,即使事前已經被 Bloomberg「暴雷」,蘋果的發表會仍然讓人驚艷。這是因為,確實只有蘋果同時做得到這兩點。以下將會慢慢解析為什麼,首先,從最明顯的「生態系」開始。

蘋果的優勢:整合與生態系

蘋果花了十數年的時間,逐步完善其生態系:

- 「裝置」:iPhone、Mac、Apple Watch、Vision Pro

- 「作業系統」:iOS、macOS

- 「軟體服務」:App Store、Apple Music、iCloud

Apple Intelligence 的加入,則將串連起整個生態系。這或許是 Siri 當初被期望要做到的事,在 13 年後終於成真。

高度的軟硬整合與垂直整合,也替蘋果打造出罕見的護城河。蘋果的每項技術,都可能成為另一項產品的基礎。我在 2023 年的 WWDC 文章〈Apple Vision Pro 與 WWDC:誠實的特權、市場定位與社會影響〉中提到過:

這是 Apple 一條罕見的護城河。許多人認為,Apple 的護城河是品牌——而這當然沒錯。然而一票死忠粉絲與高貴品牌迷思,無法真正有效排除競爭者。

我認為 Apple 真正強大的護城河,在於其產品研發極為高效,幾乎沒有冗餘。一項新技術不僅能在單一產品上使用,還同時是另一項產品的基礎。這使得研發的邊際效益極高。

Apple Silicon 不僅可替產品提供最佳體驗,也使蘋果有能力為 Vision Pro 設計更領先的晶片;如今,則用於提供 Apple Intelligence 的資料中心。

Apple Intelligence 分為三大部分:

- 跑在裝置上的數個小模型,負責基本的文字處理、搜尋

- 透過 API 連接至蘋果自建的資料中心,負責較複雜的任務

- 運行 GPT-4o 的 ChatGPT,用於處理廣泛的開放式問答。

選擇以自家的晶片自建資料中心,乍看令人困惑:為什麼不直接使用 NVIDIA?

這是為了未來的整合優勢鋪路。舉例而言,同樣的大型語言模型(LLM),跑在 Groq 上比 NVIDIA GPU 快 10 倍。原因單純是因為:Groq 針對 LLM,設計了專屬的 LPU,大幅加速生成速度。

唯有當蘋果在 AI 上也做高度的軟硬整合,才有機會提供有別於競爭對手的體驗:更快的速度、更精準的結果。

此外,另一項時常被忽略、但只有蘋果(與 Google)做得到的事:App Store 上數百萬位「開發者」。

WWDC 上展示的功能,如 Siri、圖像生成、Genmoji、Writing Tools,都提供了對應的 SDK(開發者工具),讓開發者可以直接串接。

而這其實才是 WWDC(開發者大會)的核心重點:讓開發者了解新釋出的產品能做到哪些事。相較於 Google I/O 更多是技術火力展示,蘋果並未偏離主題,仍將重心放在開發者身上。

健康平衡的生態系,是其中每個物種都能好好成長,而不是只有單一強勢物種足以存活。

然而,蘋果並非唯一擁有生態系與軟硬整合的公司。其中兩個有力的競爭對手是微軟與 Google。

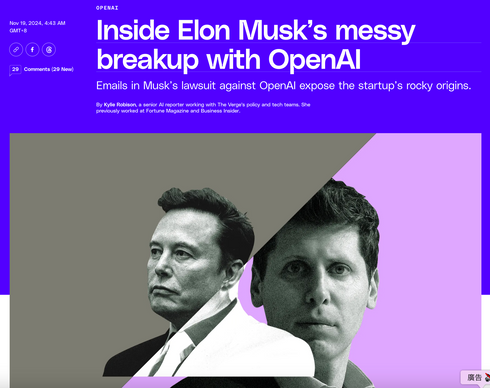

蘋果 vs 微軟

微軟在上個月發表 Recall,宣稱會隨時紀錄使用者在電腦上的一切操作,並可供搜索。然而,實際上微軟只是不斷儲存螢幕截圖,而且沒有太多保護措施。單單將螢幕截圖存在本機端,並不意味著「隱私」與「安全」——惡意軟體仍可能取得資料。

在受到強烈批評後,微軟將 Recall 功能改成預設關閉,需要生物識別驗證才會開啟。

為什麼會出現這樣的失誤?因為微軟只控制了「作業系統」,並不控制上游的「裝置」與下游的「開發者」。

在作業系統層次推出 AI 整合功能,無法保證開發者是否濫用,導致資料外洩;若想確保安全性,便需要裝置層次的生物識別,卻又會嚴重影響 AI 功能的推廣。微軟的生態系並不完整。

相較之下,只有蘋果同時控制作業系統、裝置以及開發者。每台裝置都由蘋果設計,提供作業系統層次的 AI 功能。同時,有限制地提供 SDK,開發者無法寫出 SDK 範圍外的惡意程式。

蘋果 vs Google

Google 在 2023 年發表 Gemini Nano:可運行在裝置上的 LLM,並在 2024 年 6 月 11 日宣布會在 Pixel 8、8 Pro 和 8a 上推出。目前除了「錄音逐字稿」外,尚不清楚 Gemini Nano 可以做到什麼。尚未開放給所有 Android 系統,更沒有開發者的 SDK。

我認為 Gemini 系列中,最重要的是 Gemini Nano。然而表面上,Google 似乎沉迷於競爭「世界第一的 LLM」,忽略了可運行在裝置上的模型,因而錯過整合裝置、作業系統與 AI 的先行者優勢。

為什麼 Google 會從領先到落後?蘋果又為什麼得以急起直追?這是因為兩者的商業模式有很大不同。

蘋果的商業模式是「賣硬體」,很自然地,蘋果將大多數的心力放在整合硬體與 AI。過往由於硬體的性能過剩,蘋果找不到下一個功能來推動 iPhone 銷售。跑在裝置上的 AI,將大幅拉高硬體門檻,有利於銷售。

然而,Google 的主要商業模式是「搜尋廣告」,成長中的業務則是「Google Cloud」。打造 AI 整合行動裝置,對於 Google 的營收不僅沒幫助,還是額外的大筆開銷。

此外,Google 多年來以 AI 包裝自己,卻在 2022 年底被 OpenAI 搶去鋒頭,微軟亦迅速宣布整合 AI 與 Bing 搜尋。Google 被迫回應,結果卻是:Gemini Ultra 的訓練成本預估達到 $1.91 億美元,而 AI Overview 給出了一些極為荒謬的答案。

後見之明,這些決策相當糟糕,但 Google 的確進退兩難:

- 即使 AI 搜尋明顯不夠好——Perplexity 的精準度也只能說是差強人意——Google 卻不能忽視破壞式創新的風險。

- 開發強大的 LLM,有利於 Google Cloud 的成長,吸引更多開發者將服務部署在 Google Cloud 上。

- 公關形象與股價壓力。

三項原因,最終使 Google 無法將注意力放在 Gemini Nano 上。儘管如此,具備作業系統層級 AI 的 Android,仍然是蘋果的有力競爭對手。而在蘋果訂出了新標準後,Google 要跟進將會容易許多。

但至少目前為止,只有蘋果才能專注在整合 AI 與硬體。

OpenAI:AI 代工廠

Apple Intelligence 將複雜的開放式問答交給 ChatGPT,我認為這是相當正確的決策。蘋果並不需要去爭搶「最強的 LLM」,就好比蘋果不需要與 Google 爭搶「最強的搜尋引擎」一樣。

問題是:OpenAI 在蘋果生態系中扮演什麼角色?

搜尋引擎不是好的比喻。Google 搜尋有多位競爭對手,而蘋果控制了裝置,因此控制了入口。為此,Google 需要付費給蘋果,成為預設搜尋引擎。

好一些的參照案例是 Google Maps。2012 年,蘋果強推自家的地圖取代 Google Maps,評價卻非常糟糕。蘋果無法控制地圖的入口,即使內建的地圖不是 Google Maps,我們依然會自行下載 Google Maps 來用,如同現在我們會自己去找 ChatGPT 來用。

此外,搜尋引擎有廣告商業模式,但是整合進 Apple Intelligence 的 ChatGPT 並沒有。OpenAI 沒有動機去爭搶成為預設,反倒是蘋果有動機提升 AI 體驗,而需要整合 ChatGPT。這點也與 Google Maps 相似,差別在於,當時 Google Maps 並沒有其他替代品。

我認為更好的比喻是「晶圓代工」。OpenAI 就像台積電,供應部分零件給蘋果,而蘋果勢必會尋找第二來源。除了避免 OpenAI 漫天喊價,以及 ChatGPT 臨時當機,更重要的是,Apple Intelligence 目前只提供給美國地區。當需要拓展到全世界時,ChatGPT 就可能無法應付(如:中國市場)。

OpenAI 就像蘋果的「AI 代工廠」。蘋果永遠都不需要做出最強的 LLM,就像蘋果永遠都不需要自己生產晶片。

下個十年的戰場:全新的 AI Device

短期而言,iPhone 的銷量,可能會因為 Apple Intelligence 成長。但是如同前面提到過的,一旦 Android 跟進,蘋果便很難維持優勢。類似案例是手機鏡頭:起初蘋果的攝影功能是優勢,近幾年已經逐漸難以做出差異化。

於是,我開始思考:長期而言,還有什麼是「只有蘋果能做的事」?

我認為,AI Device 會是接下來的發展方向。想像一個隨時隨地陪在身旁的 AI 助手:可同步看到你眼前的場景,並給予回覆。這樣的 Device 應該盡可能輕巧、沒有顯示器。在戶外時,可以用 Apple Watch、iPhone 作為螢幕;在室內與家中,則可以是 Mac、Vision Pro。

Apple Intelligence 或許可視為 AI Device 的起點:將 iPhone 變成一個夠好、融入使用者生活的 AI 裝置。

但手機終究是一個有點尷尬的介面。如果想要使用 AI,必須拿出手機、呼叫 Siri、執行任務,並一手拿手機,低頭看結果。此外,手機也是一個需要「學習」的介面,因此仍不夠直覺。(第一次拿到 iPhone 時如果不 Google,你知道怎麼螢幕截圖嗎?)

從商業角度,打造 AI Device 將可以創造新的消費性硬體需求,並強化生態系護城河。從社會文化角度,許多現代科技的推進都與科幻作品相關。我們對於 AI 的想像並不是手機,而是可以隨時對話的耳機,如《鋼鐵人》中的 Jarvis、《雲端情人》中的 Samantha。

可能有人會反駁,如何解釋硬體新創如 Humane Ai Pin、Rabbit R1 的失敗?

如同 Ben Thompson 所說的:“…one of Humane’s fatal flaws was their insistence that they could stand alone.” Humane 與 Rabbit 的問題,在於誤以為新科技可以獨立存在,靠一己之力快速顛覆。

人們往往高估了新科技的接受速度。新科技總是緩慢推進,可能是在社會中,一點一滴慢慢改變,或是寄生在既有的科技,讓人們不知不覺習慣。汽車並非一夕之間就取代馬車,而是經過漫長的十年;但特斯拉因為寄生在「汽車」上,因此得以讓人們慢慢習慣電動車這項科技。

事實上,過往的 VR、AR 頭戴式裝置,也犯了同樣的錯誤。然而,蘋果的 Vision Pro 有能力整合 Mac 與 iPhone,使進入市場更加順暢。若蘋果自行打造 AI Device,也同樣能享有生態系的優勢。

當然,AI Device 也有非常多技術細節待克服(其中最大的問題或許是電池),在 Apple Intelligence 發表的當下討論,似乎還距離太遠。

但是,回想十年前,即使沒有智慧型手機,我們也活得好好的;或許十年後,我們也會有類似的感受,感嘆 2024 年的我們,沒有那個未來的 AI Device,竟然也活得好好的。