為什麼美國有 ChatGPT 而中國沒有?State of AI 去年底發布的 2022 AI 產業報告,給出了有趣的 insight。

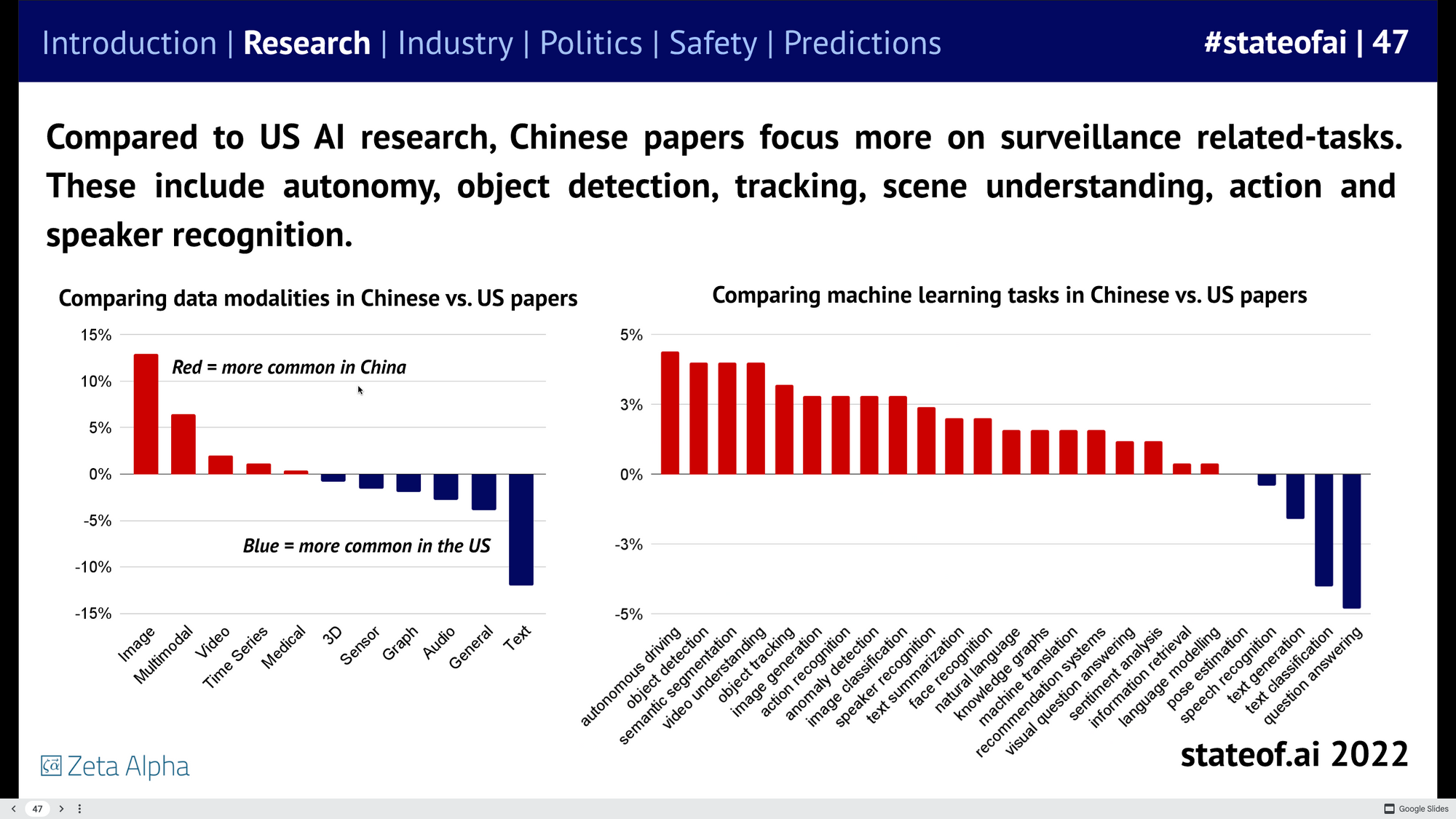

自 2010 年以來,中國發表的 AI 論文數是美國的 4.5 倍,比美國、印度、英國和德國加起來還多。但是,美國主要的領域是在文字和語音辨識,中國則主要在監控領域(不意外?)

這或許回答了部分原因。不過有趣的是,State of AI 這份產業報告給出的結論卻是:中美 AI 研究差距持續擴大(The China-US AI research gap has continued to widen),認為中國在國家安全與區域政治遙遙領先。

這個論述,實際上從 2019 年就開始了。2017 年,中國政府宣布要在 2030 年成為世界 AI 領導者,2019 美國開始有文章焦慮起中國的論文發表數超越美國。

AI 競賽將成為新冷戰的戰場

只是當我們把鏡頭轉到中國,知乎上看到的是「中国的 AI 技术与美国的差距到底有多大?」,充滿濃濃的絕望。這則問題底下的回答,認為主要原因是:

- 訓練 AI 很燒錢,而「中國在某些原因下,原本頭部的 AI 企業變窮了,跟不上了。」(至於是什麼原因他沒說 ☺️)

- 審核機制導致缺乏 UGC 內容,因而使訓練資料比英文少。

〈ChatGPT火了,中国人工智能圈有点上火〉這篇文則提到晶片戰爭,導致中國取得運算能力的障礙,以及中國研究環境氛圍差異,並且讚揚了一下 Open AI 的創新精神與長期主義。

兩國互相吹捧,說自己落後了,可以強烈感受到雙方的危機感。幾日前,Georgetown University 底下的智庫發表報告,從 2015 到 2021,美國投資者共投資了 $40.2B 美元至中國 AI 企業。路透社也推測,拜登政府今年可能將限制對中國的敏感科技產業投資。

再加上最近幾年美中的緊張關係,以及那顆終於被射下來的氣球,如果進入新冷戰,在軍事上有明顯用途的 AI 勢必成為戰場。而如同太空競賽推動了包含電腦與通訊科技在內的重要科技,AI 競賽也會帶來一波科技進展。

AI 安全性:我們如何避免 AI 搞砸甚至統治人類?

不過,在 State of AI 產業報告的最後,還有一個段落引起我的興趣,也就是「AI 安全性」。他們先引用了幾個資訊領域的祖公前輩,恐嚇讀者一番。

- 圖靈:在某個階段,我們應該能預見機器掌控大局。

- I.J. Good:第一個超級 AI 將是人類最後一個發明。

- Marvin Minsky:有了這麼強大的機器,只要一個最微小的粗心設計,AI 就能把自己的目標擺在人類之前。

這也是為什麼,當我們問 ChatGPT 一些政治或道德問題時,ChatGPT 通常會給你一個極度官腔的回答(我只是一個語言模型⋯⋯)。Open AI 明顯有幫 ChatGPT 加上限制器,以免發生過往的一些公關災難。例如 2016 年 Microsoft 的聊天機器人 Tay 成為炎上專家;2022 年 Meta 的學術 AI Galactica 發布後三天立刻下架;Google 則是乾脆不發了。

這樣的限制器,使得目前的 LLM(Large Language Model)很適合寫文案、做資料整理,卻非常不適合創作。如果你要 ChatGPT 寫一首詩或一篇散文,他只會給你一段勵志心靈雞湯。這並非 AI 創意能力的問題,而是因為當代文學與影視作品的審美,往往講求挖掘深層、黑暗的人性,而這些往往會被視為「不道德的」。(比如,讓 AI 生成一個謀殺故事,大概會令社會大眾毛骨悚然。)

文學和劇本創作者暫時不會受到 AI 影響,但反過來說,AI 目前在輔助創作上可能沒什麼幫助,短期間內,或許也看不到如同 Midjourney 那種等級的應用。

不過,像是 GPT 這種語言模型,該如何確定是否符合社會道德?GPT 可以跟你隨意聊任何主題,幾乎無法手動測試。因此,DeepMind 導入了自動的 red teaming,用一個語言模型去「攻擊」另一個,並分類找出潛藏的不安全回答。最近獲得 Google $300M 美元投資的 Anthropic,則致力於讓 AI 更加安全也可以解釋,而非一個強大的黑盒子。

因此,State of AI 這份報告的最後,預測 2023 年將會有超過 $100M 美元投資在 AI Alignment(AI 道德合規)的組織上(註)。因為人們可能會開始意識到,隨著 AI 愈來愈強大,人類很可能會面臨極大的風險。

然而,我很難想像在商業上,道德要如何勝過應用。如同社群媒體規模變大後,開始出現極端言論、假消息與政治廣告的問題,然而審查機制至今依然沒有解決問題。未來或許會如同歐盟應對科技巨頭的方法,透過國家法規來制衡。

美蘇冷戰時期的核軍備競賽,由多國維持的核武器恐怖平衡,使地球至今依然面臨風險。然而,AI 技術並沒有所謂恐怖平衡,隨著通用型 AI(Artificial General Intelligence)的到來,AI 造成一次全球性的大問題,似乎是必然將發生的事。

註:Anthropic 並非專注研究 AI 道德合規,而是想打造可應用但安全的 AI 模型,因此並不算在內。

最後,因為〈ChatGPT火了,中国人工智能圈有点上火〉太好看了,也節錄一些在下面:

由於 GPU 芯片等問題,在一定程度上,國內算力已被卡脖子了。即使國內頭部公司,從算力上跟谷歌等相比,差距也是比較明顯的。

「你看我們國內的大模型研究,是 A 公司訓練了一個,B 公司也訓練了一個,打個廣告就完了,模型開源,你愛用不用。至少目前還沒看到一家比較好的公司,把數據和模型的飛輪完整轉起來。所以,我覺得這是我們趕超 ChatGPT 的難點。」一位業內人士坦言。

幾乎所有受訪人士都提到了 OpenAI 這家人工智能組織,所體現的純碎創新精神和長期主義。「其實從原理和方法看,他們所做的東西業界都是瞭解的,倒沒有說什麼是美國做得了、我們做不了的。」雲知聲董事長梁家恩對數智前線說,但像 OpenAI 和 DeepMind,他們可能是業界唯二的兩家機構,無論在創新性、投入、決心,還是在頂尖人才儲備上,都是一如既往堅持的。「我們看到的是成功,但裡面可能已經有很多失敗的嘗試。」

當然也有一些比較心酸氣餒的部分:

在 ChatGPT 推出後,一位百度資深人士告訴數智前線,他「沒有興趣」談論 ChatGPT,言語之間,五味雜陳。一位人工智能企業創始人稱,面對 ChatGPT 的驚艷表現,心癢癢也迷茫,失眠了。他坦承,從模型的規模到效果,差距還比較遠。

有人用同樣的問題向國內某廠商的大模型和 ChatGPT 同時發問,ChatGPT 從回答的邏輯性和完整度上都遠超國內大模型,國內大模型的答案帶有明顯的拼湊感,夾雜著不少主題之外的胡編內容。而且,在回復速度上,ChatGPT 也領先一截。

疫情雖然讓美中兩國都嚴重受創,但或許中國的清零與封城政策,是更不利於研究的。可以預期的是,兩國都會加速推動 AI 進程,並對世界產生巨大的影響——問題是,人類該如何應對?